Sous-total 0.00CFA

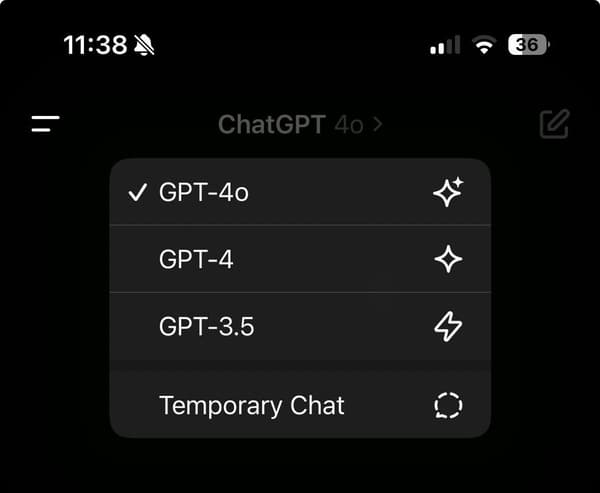

GPT-4o est enfin là. OpenAI accélère son développement. Le lundi 13 mai, la société a présenté un nouveau modèle qui peut interagir avec des images et des vidéos en plus du texte. De plus, il est capable d’engager une conversation en temps réel avec les humains par la voix.

Des conversations fluides et de nombreux usages grâce à GPT-4o

Le choix du moment était idéal, juste avant la conférence I/O de Google, la grande concurrente d’OpenAI. Lors d’un événement de trente minutes, Mira Murati, la directrice technologique de la start-up, a dévoilé GPT-4o. Le “o” représente “omni”, soulignant la capacité du modèle à traiter texte, parole et vidéo.

Bien qu’OpenAI ait précédemment lancé une version vocale de ChatGPT, celle-ci manquait parfois de précision et de naturel, en raison de l’assemblage de trois modèles distincts. GPT-4o, en revanche, est un modèle unique, formé sur des données textuelles, visuelles et auditives, lui permettant de réagir avec plus de rapidité et de précision.

Avant cette présentation, plusieurs cadres d’OpenAI, y compris le PDG Sam Altman, ont évoqué le film “Her”, sorti en 2013, qui raconte l’histoire d’un homme s’éprenant de son assistant vocal, une IA douée pour la conversation comme un humain.

Dans plusieurs démonstrations partagées par OpenAI, le nouveau modèle a montré l’étendue de ses capacités, capable de jouer à “pierre-papier-ciseaux”, d’assister un étudiant en mathématiques ou de traduire des langues en direct. De plus, l’IA peut également détecter les émotions à travers le ton de la voix ou les expressions faciales.

La révolution des assistants personnels ?

OpenAI a choisi de déployer gratuitement ChatGPT pour tous les utilisateurs « dans les prochaines semaines ». Cette décision est logique alors que les géants de la technologie, tels que Google et Apple, aspirent à transformer leurs assistants personnels avec l’IA générative.

Apple envisage d’améliorer Siri avec l’IA générative et pourrait être sur le point de conclure un accord avec OpenAI pour intégrer cette technologie dans iOS 18. Est-ce que cela inclura GPT-4o ? Il est trop tôt pour l’affirmer, mais c’est une éventualité.

Il est important de souligner que les dirigeants d’OpenAI n’ont pas précisé quelles données ont servi à entraîner le modèle, ce qui est un sujet de controverse dans le domaine de l’intelligence artificielle. On ne sait pas non plus si GPT-4o a été développé avec moins de ressources de calcul que ses prédécesseurs.

Il semble néanmoins clair que cette nouvelle technologie pourrait représenter un changement majeur dans le domaine de l’IA et, en particulier, pour les assistants virtuels.